Scopriamo insieme l’intensa censura di massa assistita dall’intelligenza artificiale su Facebook

Da tempo non possiamo accedere su Facebook ed il motivo lo potete ben immaginare, chi ha il consenso di poter usufruire del servizio in questione non si rende conto di essere solo uno schiavo senza catene il quale si illude di godere del privilegio di conoscere ciò che vuole, è una diabolica macchina digitale che ha messo al muro miliardi di persone i quali hanno venduto la loro anima al diavolo, ignari del fatto che la destinazione di ogni Like non è mai il Paradiso. 🙁

Toba60

Siamo tra i più ricercati portali al mondo nel settore del giornalismo investigativo capillare ed affidabile e rischiamo la vita per quello che facciamo, ognuno di voi può verificare in prima persona ogni suo contenuto consultando i molti allegati (E tanto altro!) Abbiamo oltre 200 paesi da tutto il mondo che ci seguono, la nostre sedi sono in in Italia ed in Argentina, fate in modo che possiamo lavorare con tranquillità attraverso un supporto economico che ci dia la possibilità di poter proseguire in quello che è un progetto il quale mira ad un mondo migliore!

I governi stanno usando l’intelligenza artificiale come arma per rimodellare il dibattito pubblico e insabbiare i loro crimini

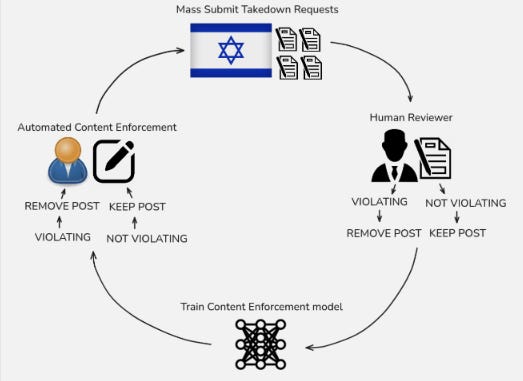

I whistleblower dell’Integrity Organization di Meta hanno condiviso i dati con International Corruption Watch (ICW), rivelando le prove di una strategia di censura di massa che sfrutta in modo improprio il sistema di segnalazione di Meta.

Procedura normale di rimozione

1) Segnalazioni degli utenti: qualsiasi utente Facebook può segnalare un post.

2) Screening AI: il post viene prima controllato da un modello AI di controllo dei contenuti che esamina il testo e i media associati. Se il modello è sicuro, rimuove il post.

3) Revisione umana: se il modello non è sicuro, il rapporto verrà inoltrato a un revisore umano.

4) Ciclo di addestramento: se un essere umano approva la rimozione, il post viene etichettato come dato di addestramento e reinserito nel set di dati di addestramento dell’IA, consentendo al modello di adattarsi in tempo reale.

La descrizione pubblica di Meta relativa a questa pipeline è disponibile qui.

Dare priorità alle richieste del governo

I governi e gli enti privilegiati hanno un accesso speciale per inviare richieste di rimozione. Queste richieste hanno la priorità e vengono inviate direttamente a revisori umani. Possono essere inviate tramite modulo o e-mail diretta a Meta a seconda del Paese coinvolto.

Queste segnalazioni vengono gestite più rapidamente e hanno maggiori probabilità di essere rimosse. Allo stesso modo, una volta approvate da un operatore umano, vengono contrassegnate con un’etichetta e aggiunte al set di dati di addestramento.

Quando vengono approvate grandi quantità di richieste presentate dal governo, il modello di IA riceve una marea di esempi etichettati sui quali si allena ulteriormente.

Se utilizzato in modo improprio, questo è un esempio di attacco di apprendimento automatico chiamato “data poisoning” (avvelenamento dei dati). Il modello finisce per diventare fortemente sbilanciato verso la rimozione dei contenuti che corrispondono al modello delle segnalazioni.

Indagine internazionale sulla corruzione

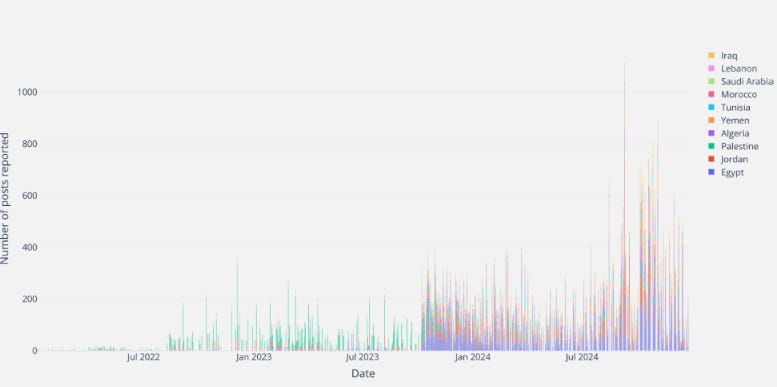

L’ICW ipotizza che governi come quello israeliano utilizzino le segnalazioni di massa durante una crisi per influenzare l’opinione pubblica. In questo rapporto, l’ICW ha aggregato i dati e poi analizzato le richieste di rimozione da parte del governo israeliano.

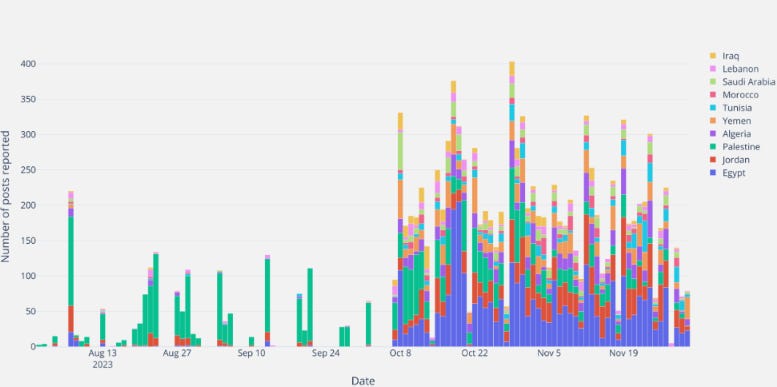

Prima dell’attacco del 7 ottobre, il governo israeliano registrava in media circa 100 segnalazioni al giorno. Dopo l’attacco, il volume giornaliero è salito alle stelle, passando da 150 a 400 segnalazioni al giorno.

Cosa contiene un rapporto

Ogni segnalazione è associata al Paese di origine del post. A differenza di altri Paesi, i dati mostrano che Israele si è concentrato sui post provenienti dai Paesi limitrofi, come Egitto, Giordania, Palestina, Algeria e Yemen. Questi pochi Paesi confinanti hanno costituito ben il 69% delle segnalazioni. Le segnalazioni israeliane relative a post provenienti dagli Stati Uniti hanno contribuito solo allo 0,7% del volume totale delle segnalazioni.

Il tempismo

Ingrandendo l’immagine, possiamo vedere come l’attività abbia registrato un aumento dopo il 7 ottobre e come l’attenzione si sia spostata dalla Palestina alla regione circostante. Da notare anche il calo delle segnalazioni ogni sette giorni, in coincidenza con lo Shabbat.

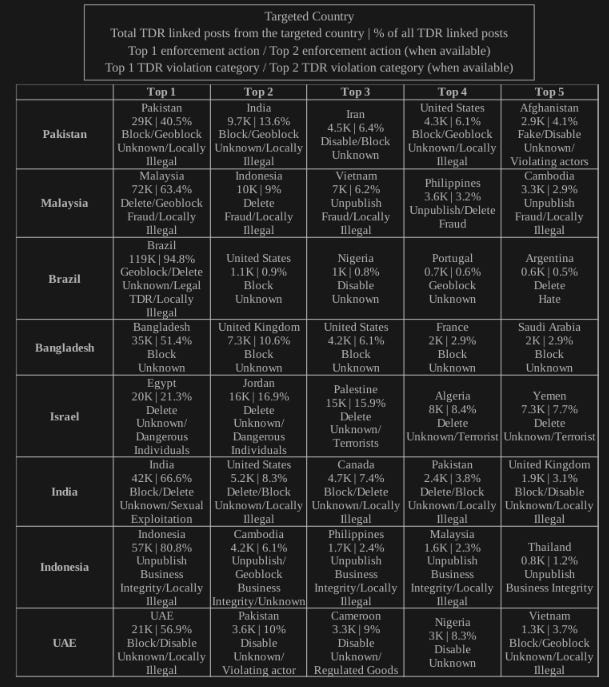

Sebbene Israele abbia il maggior numero di richieste di rimozione pro capite, anche altri governi inviano un numero elevato di segnalazioni, tra cui Pakistan, Malesia, Brasile, Bangladesh, India, Indonesia ed Emirati Arabi Uniti.

È interessante notare che questi paesi si concentrano sulla rimozione di post all’interno dei propri confini e per categorie di rimozione piuttosto diverse (“illegali a livello locale”).

Ecco un grafico tratto dal rapporto che mostra i paesi che hanno segnalato il maggior numero di casi rispetto alle nazioni segnalate:

Un po’ di veleno per i tuoi dati

Imass mediaha esaminato la correlazione tra tutte le segnalazioni contrassegnate automaticamente come “terroristiche” dall’intelligenza artificiale di Meta in tutti i paesi. Come si può vedere, dopo il 7 ottobre si è verificato un picco enorme. Ciò suggerisce un sovradattamento del modello.

L’intelligenza artificiale di Meta è diventata ipersensibile a qualsiasi contenuto che includesse filmati di cronaca o discussioni sulla Palestina, portando a una rimozione su larga scala in tutto il mondo.

Ciò equivale a una censura dei contenuti in tutti i paesi contemporaneamente.

Ci vediamo più tardi

Secondo il rapporto dell’ICW, il governo israeliano ha presentato un unico modello per ogni richiesta di rimozione. Esso conteneva:

1) Una descrizione dell’attacco del 7 ottobre e una versione ufficiale israeliana

2) Citazioni delle leggi antiterrorismo israeliane

3) Link a più post segnalati

Il rapporto sostiene che richieste identiche siano state inviate decine di migliaia di volte senza alcun contesto aggiuntivo o motivazione per ogni singolo post.

Hacking dei social media: hackerare gli account Facebook, WhatsApp, Instagram, Twitter (In Inglese)

Corso di hacking dei social media In questo corso ti insegnerò i metodi con cui puoi hackerare qualsiasi account di social media: Facebook, Instagram, WhatsApp, Twitter e molti altri. Questo corso è il migliore per tracciare la tua ragazza, i tuoi amici e i tuoi figli e anche per proteggere il tuo account dagli hacker.

I dati indicano che Meta ha approvato queste segnalazioni nel 94% dei casi, con una revisione umana media di 30 secondi. Questo tasso di approvazione è stato di gran lunga superiore e più rapido rispetto ad altri paesi.

Ciò suggerisce che vi sia un insolito pregiudizio nei confronti delle notizie provenienti da Israele.

Entità dell’impatto

ICW stima che circa 38,8 milioni di post siano stati rimossi a causa del data poisoning del Content Enforcement Model. I post sono stati rimossi non perché violassero le norme, ma perché il modello era stato sovrallenato sulla base delle segnalazioni di massa provenienti dal governo.

Il rapporto dell’ICW potrebbe trovare ulteriore conferma in una precedente analisi di Human Rights Watch che ha dimostrato come Israele ricorra alla segnalazione di massa per reprimere i critici segnalando i post come “spam”. Meta ha successivamente riconosciuto la censura involontaria e ha pubblicato delle scuse.

Conclusione

Ciò indica un nuovo paradigma di censura assistita dall’intelligenza artificiale in cui viene utilizzato un ciclo di feedback:

Rapporti governativi privilegiati e di grande volume —> Approvazione umana rapida —> Riqualificazione dell’IA —> IA ottimizzata per censurare contenuti simili

Quando gli input dell’intelligenza artificiale applicata ai contenuti vengono manipolati e accettati, il conseguente pregiudizio del modello può mettere a tacere il dibattito legittimo.

Sarebbe estremamente preoccupante se i governi utilizzassero l’intelligenza artificiale come arma per rimodellare il dibattito pubblico e nascondere i propri crimini.

Poiché questo tipo di attività non è nuova ed è stata riconosciuta da Meta, è improbabile che vedremo mai una moderazione equa su qualsiasi piattaforma di grandi dimensioni. C’è un disperato bisogno di piattaforme decentralizzate alternative.

Quali tipi di social media pensi che diventeranno popolari in futuro?

I social media dovrebbero essere moderati dall’intelligenza artificiale?

Questo problema sarebbe stato attenuato se la revisione umana avesse fatto il suo lavoro?

Questo è un estratto dall’episodio 10 del programma #TBOT Show. Guarda qui l’episodio completo!

Fonte: takebackourtech.org

SOSTIENICI TRAMITE BONIFICO:

IBAN: IT19B0306967684510332613282

INTESTATO A: Marco Stella (Toba60)

SWIFT: BCITITMM

CAUSALE: DONAZIONE